Utrzymanie Pulsu w Maszynie: Argumenty za Ujawnieniami AI Zorientowanymi na Człowieka

Sztuczna inteligencja nie jest już ograniczona do zaplecza biurowego. Od chatbotów obsługujących złożone zapytania po robo-doradców tworzących podsumowania portfeli, AI coraz częściej funkcjonuje jako podstawowy kanał przekazywania informacji finansowych. Chociaż ta zmiana zapewnia efektywność i skalowalność, rozmywa „ludzki dotyk" w wyjaśnianiu ryzyka – ludzki doradca może wyczuć wahanie klienta i zaoferować niuansowe wskazówki, których interfejs AI, zoptymalizowany pod kątem szybkości i przejrzystości, często pomija.

W kontekście Republiki Południowej Afryki stwarza to paradoks. Ujawnienia oparte na AI obiecują demokratyzację dostępu do informacji finansowych, jednak wprowadzają nieprzejrzyste ryzyka zagrażające uczciwości, ochronie konsumentów i stabilności systemowej. W miarę integracji tych technologii, innowacja nie może odbywać się kosztem ochrony klientów.

Podstawy regulacyjne: POPIA, TCF i zarządzanie

Ramy regulacyjne Republiki Południowej Afryki stanowią solidną podstawę do zarządzania ryzykiem AI, mimo że nie zostały zaprojektowane z myślą o uczeniu maszynowym.

Ustawa o ochronie danych osobowych (POPIA) ma bezpośrednie zastosowanie. Finansowe modele AI opierają się na ogromnych zbiorach danych, historiach kredytowych, danych demograficznych i behawioralnych, a przetwarzanie musi pozostać zgodne z prawem, przejrzyste i zgodne z pierwotnym celem gromadzenia. Co istotne, Sekcja 71 przyznaje klientom prawo do zakwestionowania decyzji podejmowanych wyłącznie za pomocą procesów automatycznych, gdy te decyzje niosą konsekwencje prawne. W miarę jak automatyczna ocena zdolności kredytowej i underwriting stają się standardem, instytucje muszą zapewnić jasną ścieżkę, aby klienci mogli zażądać przeglądu przez człowieka.

AI może wzmocnić wyniki w zakresie uczciwego traktowania klientów (TCF) poprzez zapewnienie spójnego stosowania kontroli dostępności cenowej. Jednak jeśli model jest szkolony na historycznie stronniczych danych, może generować dyskryminacyjne wyniki, naruszając zasadę uczciwego traktowania TCF. Natura „czarnej skrzynki" głębokiego uczenia dodatkowo komplikuje Wynik 3 (jasne informacje) i Wynik 4 (odpowiednie porady) – jeśli instytucje nie mogą wyjaśnić, jak osiągnięto wynik, znaczące ujawnienie staje się trudne.

King V dotyczący ładu korporacyjnego (październik 2025) wzmacnia te zobowiązania: Zasada 10 jasno określa, że zarządy muszą angażować się w etyczne, prawne i strategiczne konsekwencje automatycznego podejmowania decyzji. AI to nie tylko kwestia IT.

Uczciwość, przejrzystość i ochrona

Modele AI wyszkolone na historycznych danych z Republiki Południowej Afryki ryzykują odtworzenie zakorzenionych nierówności społeczno-ekonomicznych. Nawet tam, gdzie chronione cechy, takie jak rasa, są wykluczone, zmienne zastępcze – kody pocztowe, poziomy wykształcenia, wzorce zatrudnienia – mogą przynieść funkcjonalnie podobne dyskryminacyjne wyniki, ograniczając dostęp do kredytu lub ubezpieczenia w oparciu o czynniki systemowe, a nie indywidualne zasługi.

Przejrzystość musi być znacząco skalibrowana. Ujawnienie musi wykraczać poza proste zastrzeżenie: konsumenci zasługują na jasne wyjaśnienia, jak AI wpływa na wyniki ich dotyczące, wraz z informacjami o ich prawie do zadośćuczynienia. Dla regulatorów nacisk przesuwa się na zarządzanie i interpretowalność – dowód, że podmiot rozumie logikę modelu i zabezpieczenia, które są na miejscu.

Generatywna AI wprowadza dodatkowe ryzyko „halucynacji" – wiarygodnych, ale faktycznie nieprawidłowych wyników. System AI zoptymalizowany pod kątem konwersji leadów może nieumyślnie skłaniać klientów do produktów wysokiego ryzyka poprzez bagatelizowanie ostrzeżeń o ryzyku. Filtry wyjściowe muszą zabronić AI obcinania obowiązkowych ujawnień ryzyka.

Utrzymanie stabilności systemu finansowego

Analityk monitorujący ekran danych. Freepik

Analityk monitorujący ekran danych. Freepik

Poza indywidualnymi interakcjami, AI wpływa na szerszą stabilność systemową. Pomaga regulatorom natychmiast skanować ogromne zbiory danych w celu wykrycia oszustw lub niewypłacalności, działając jako szybszy system wczesnego ostrzegania niż sama analiza ludzka. Może również tłumaczyć złożony żargon finansowy na dostępny język, zmniejszając wskaźniki niewypłacalności poprzez poprawę zrozumienia konsumentów.

Jednak nadmierne poleganie na niewielkiej liczbie dużych modeli językowych (LLM) tworzy ryzyko koncentracji: wiele instytucji może identycznie interpretować sygnały rynkowe i reagować jednocześnie, zaostrzając zmienność lub wywołując błyskawiczne krachy. Błąd wygenerowany przez AI w ważnym publicznym ujawnieniu może natychmiast się rozprzestrzeniać, wywołując automatyczne odpowiedzi handlowe, zanim ludzie zdążą skorygować dane. Jeden błąd w szeroko stosowanym modelu oceny kredytowej może jednocześnie wpłynąć na miliony klientów w różnych bankach.

Rozważania dla południowoafrykańskich instytucji finansowych

W miarę jak instytucje przechodzą od eksperymentów z AI do pełnoskalowego wdrożenia, ramy zarządzania muszą ewoluować. Protokoły Human-in-the-Loop (HITL) powinny obejmować:

- Obowiązkowy przegląd: Automatyczne ujawnienia związane z wiążącymi umowami lub decyzjami o dużym wpływie powinny uruchamiać obowiązkowy przegląd przez człowieka.

- Przełącznik awaryjny: Zespoły operacyjne powinny być uprawnione do natychmiastowego zawieszenia narzędzi AI, gdy zostanie wykryty wzorzec halucynacji.

- Audyty uczciwości: Regularne testowanie przy użyciu syntetycznych person odzwierciedlających różnorodność Republiki Południowej Afryki – języki, wiek, wykształcenie i poziomy dochodów – aby zapewnić spójną jasność i ton.

- Monitorowanie wyników: Śledzenie wskaźników wydajności we wszystkich grupach demograficznych, nie tylko wskaźników skarg, biorąc pod uwagę luki w umiejętnościach cyfrowych, które mogą uniemożliwić niektórym grupom zgłaszanie problemów.

- Odpowiedzialność: Zasada „posiadacza licencji": outsourcing technologii nie oznacza outsourcingu odpowiedzialności.

- Umowy o poziomie usług: Umowy z dostawcami powinny zawierać wyraźne klauzule dotyczące wyjaśnialności modelu i odpowiedzialności za halucynacje powodujące szkody finansowe.

AI to narzędzie, a nie człowiek. W Republice Południowej Afryki, gdzie włączenie finansowe i ochrona klientów są najważniejsze, AI musi wyjaśniać krajobraz finansowy, a nie go zaciemniać. Poprzez oparcie wdrożenia na zasadach POPIA, TCF i King V oraz osadzenie silnego zarządzania i nadzoru ludzkiego, instytucje finansowe mogą wykorzystać potencjał AI bez narażania uczciwości czy stabilności. Właściwie wykorzystywana, AI nie zastępuje roli człowieka, ale ją podnosi, pozwalając profesjonalistom skupić się na osądzie, kontekście i odpowiedzialności, których maszyny nie mogą odtworzyć.

Ramy zarządzania dla odpowiedzialnego wdrażania AI w finansach

- Nolwazi Hlophe | Starszy specjalista: FinTech | FSCA | Dr Johann van der Lith | Starszy specjalista: Ramy regulacyjne | FSCA

* Urząd Nadzoru nad Sektorem Finansowym (FSCA) reguluje i nadzoruje postępowanie rynkowe instytucji finansowych w Republice Południowej Afryki. Odwiedź www.fsca.co.za.

Możesz także polubić

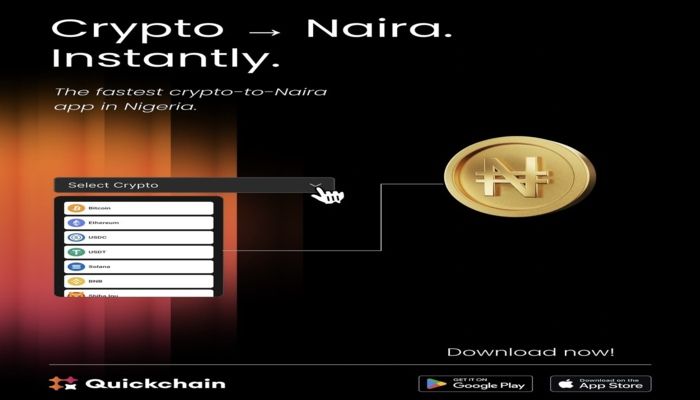

Jak QuickChain upraszcza konwersje kryptowalut na nairy w rozwijającej się gospodarce cyfrowej Afryki

Rozwój, determinacja i wpływ: Kobiety, które kierują się celem w Jollibee Group